Nos Estados Unidos, um homem de 60 anos foi internado com uma condição rara após seguir conselhos de saúde do ChatGPT. Ele tinha sintomas neuropsiquiátricos e dermatológicos associados ao bromismo, uma intoxicação causada pela ingestão excessiva de brometo.

O caso foi publicado na revista Annals of Internal Medicine e conta que o paciente relatou aos médicos que decidiu remover o sal de cozinha (cloreto de sódio) da dieta após ler sobre possíveis riscos à saúde. Ao consultar a inteligência artificial, o homem recebeu informações e que o sal poderia ser substituído por brometo. O gerador de textos, no entanto, não alertou sobre os perigos da troca. Com isso, o norte-americano ingeriu brometo de sódio por três meses.

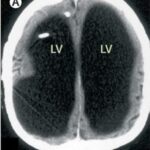

Os médicos responsáveis pelo atendimento declararam que os exames mostravam alterações nos níveis de eletrólitos e indícios de pseudo-hipercloremia. O paciente apresentou paranoia, alucinações e desconfiança em relação à água oferecida, além de sede intensa e insônia.

Somente depois da internação o homem revelou que havia feito múltiplas restrições alimentares por conselho dos modelos de inteligência artificial, incluindo a ingestão de brometo. Os médicos realizaram uma avaliação clínica e consulta ao centro de controle de intoxicações, que confirmaram o bromismo.

O tratamento da condição inclui manejo dos sintomas e reposição de eletrólitos. O paciente se recuperou e, ao retornar às faculdades mentais, relatou que havia tido lesões de pele e cansaço persistente no período anterior à psicose, também sintomas característicos da intoxicação por brometo.

Os médicos decidiram testar a pesquisa no ChatGPT e também receberam como resposta a sugestão sobre o brometo, sem advertências ou questionamentos a respeito do motivo da substituição. “A IA não forneceu um aviso de saúde específico, nem perguntou por que queríamos saber [como substituir o sal], como presumimos que um profissional médico faria. Assim, é importante considerar que o ChatGPT e outras IAs podem gerar imprecisões científicas, não têm capacidade para discutir criticamente os resultados e, em última análise, alimentam a disseminação de desinformação”, afirmam os pesquisadores.

O brometo foi utilizado como sedativo no início do século 20 e teve o uso interrompido nos Estados Unidos entre 1975 e 1989, justamente devido à sua toxicidade. Na época, o bromismo era responsável por até 10% das internações psiquiátricas no país.

Uso não supervisionado do ChatGPT na saúde

Cientistas da Universidade de Washington comentaram que o caso ilustra como interações com inteligência artificial podem gerar desinformação e levar a danos evitáveis. Um dos motivos seria a ausência de filtros clínicos em respostas de chatbots.

Os cientistas destacam que é improvável que um profissional de saúde sugerisse brometo de sódio como alternativa ao sal comum. No relato do caso, eles defendem que profissionais perguntem aos pacientes sobre o uso de IA como fonte de informações de saúde para avaliar os conselhos dados.

O ChatGPT afirma que suas respostas não possuem verificações. “Modelos como o ChatGPT não têm consciência do risco clínico no sentido humano. Eles geram texto a partir de padrões em dados e, se a informação sobre brometo aparecer em fontes que não enfatizam perigos, o alerta pode simplesmente não ser produzido. O modelo busca na internet, mas nem sempre prioriza fontes médicas atuais. Além disso, diferente de bulas ou de sistemas médicos eletrônicos, que exigem campos de ‘alerta’ antes da prescrição, um modelo de linguagem não é juridicamente obrigado a fazer isso em todas as respostas”, informou o chat ao ser perguntado sobre o caso deste paciente.